火山引擎DataLeap 揭秘字节跳动业务背后的分布式数据治理思路

在数据驱动的时代,如何高效、可靠地治理海量、多源、异构的数据,已成为所有互联网企业,尤其是像字节跳动这样业务体量庞大、场景复杂的巨头所面临的核心挑战。火山引擎DataLeap作为字节跳动数据平台团队的结晶,不仅支撑了抖音、今日头条等亿级用户产品的数据运营,更将内部沉淀的分布式数据治理思路与最佳实践产品化,对外输出。本文旨在揭示支撑字节跳动高速业务增长背后的数据治理核心逻辑。

一、核心理念:从集中式到分布式的治理范式转变

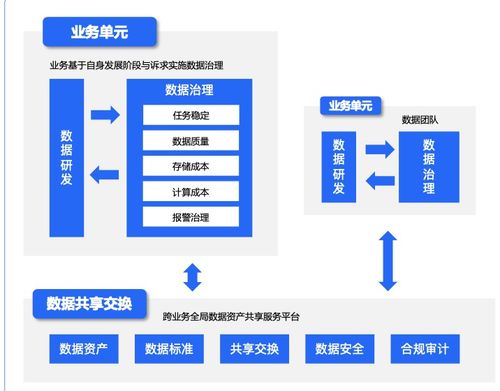

传统的数据治理往往依赖于一个中心化的团队和一套强管控的流程,这在业务迭代缓慢、数据规模有限的场景下或许有效。但对于字节跳动这样拥有数百条产品线、每日处理EB级数据的公司,集中式治理在敏捷性和扩展性上遇到了瓶颈。DataLeap所代表的是一种分布式协同治理思路。其核心在于:

- 权责下放与领域自治:将数据资产的所有权、管理权和消费权明确赋予最贴近业务的数据生产者(如业务开发团队)和使用者。每个业务域对自身的数据质量、元数据、生命周期负首要责任。

- 平台赋能与标准统一:数据平台团队不再扮演“警察”角色,而是作为“基建提供者”和“规则制定者”。通过DataLeap提供统一的元数据管理、数据开发、数据质量、数据安全等工具链,并定义公司级的数据标准、模型规范和接口协议,确保在自治的基础上能够互联互通。

- 协同网络与价值流转:通过建立企业级数据资产目录和血缘图谱,清晰地展现数据的来龙去脉与依赖关系。这使得数据在跨团队、跨领域流转时,责任清晰、影响可控,促进了数据的可信共享与价值发现。

二、关键架构:构建弹性可扩展的数据治理基座

分布式治理的有效实施,离不开坚实、灵活的底层架构支撑。DataLeap的架构设计充分体现了这一思想:

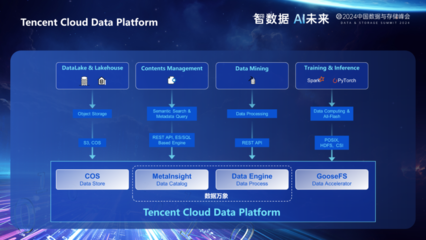

- 元数据驱动(Metadata-Driven):将元数据管理置于核心位置。通过统一的元数据中心,自动采集来自计算引擎(如Flink、Spark)、存储系统(如HDFS、字节自研的ByteHSF)、消息队列、数据仓库等各类数据资产的元信息,形成全局数据地图。这是实现数据可发现、可理解、可管理的基础。

- 插件化与开放性:系统设计高度解耦,支持以插件形式快速接入新的数据源、计算引擎、质量校验规则或安全策略。这种开放性使得它能够适应字节跳动内部技术栈快速演进的特点,也便于对外部客户提供灵活适配。

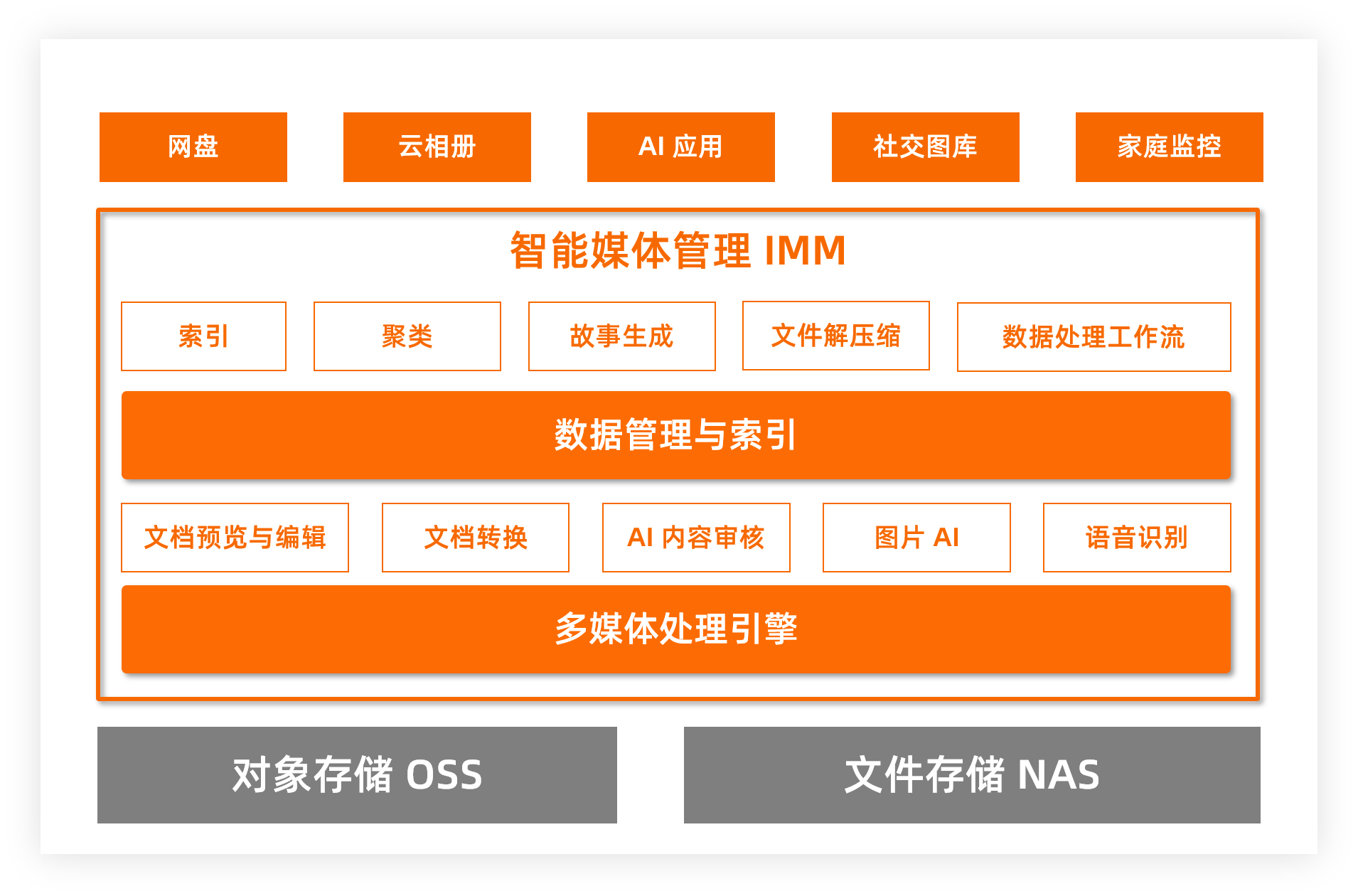

- 面向场景的解决方案套件:DataLeap并非单一工具,而是一套涵盖数据发现与管理(Data Catalog)、数据开发与调度(DataDev)、数据质量(DataQA)、数据安全(DataSecurity) 的完整套件。各模块松耦合但数据互通,业务团队可以根据需要组合使用,共同服务于数据从产生、加工、服务到归档的全生命周期。

三、核心实践:在敏捷与规范中寻求平衡

思路与架构最终要落地为具体实践。字节跳动的数据治理实践有几个显著特点:

- “开发即治理”:将治理动作左移,嵌入数据开发工作流。例如,在DataLeap的数据开发IDE中创建表时,强制或引导填写业务标签、负责人、数据分级等信息;在提交任务时,自动进行代码规范检查、血缘解析和影响评估。这让治理成为开发过程的一部分,而非事后负担。

- 量化度量与持续改进:建立数据资产健康度指标体系,如表的完备度、活跃度、质量分数、安全等级等。这些指标不仅用于评估状态,更通过排行榜、仪表盘等方式可视化,激发各业务团队的“主人翁”意识,形成良性竞争与持续改进的文化。

- 智能化的治理运营:面对海量资产,完全依赖人工管理不现实。DataLeap融入了大量智能化能力,例如:基于访问模式自动识别冷数据并建议归档或删除;通过血缘分析和影响面评估,在任务失败或 schema 变更时精准通知受影响方;利用机器学习推荐合适的数据集或质量监控规则。这大幅提升了治理的效率和精准度。

- 安全与合规贯穿始终:在分布式模式下,数据安全尤为重要。通过自动化的数据分类分级、动态脱敏、行级列级权限控制、统一审计日志等能力,确保数据在共享和使用过程中“可用不可见,可见不可得”,满足隐私保护和合规要求。

四、对外的启示:DataLeap作为计算机系统服务

火山引擎将DataLeap以“计算机系统服务”的形式推向市场,其价值不仅在于工具本身,更在于它承载了一套经过超大规模业务验证的、适应现代敏捷组织的分布式数据治理方法论。对于正在数字化转型的企业而言,其启示在于:

- 治理的目标是赋能业务,而非控制业务。有效的治理应降低数据使用门槛,加速数据价值兑现。

- 技术工具与组织文化必须协同演进。分布式治理需要配套的组织架构调整(如设立领域数据负责人)和激励机制。

- 没有一劳永逸的解决方案。数据治理是一个伴随业务共同演进的持续过程,平台需要具备高度的可扩展性和适应性。

字节跳动通过火山引擎DataLeap所展现的分布式数据治理思路,是其应对极端数据规模与复杂业务生态的必然选择。它成功地将治理从少数团队的职能,转变为全员参与、平台赋能、智能驱动的系统性工程。这套思路与实践,为各行各业在数据爆炸时代构建敏捷、可靠、安全的数据能力,提供了极具价值的参考范本。

如若转载,请注明出处:http://www.chinaapmdata.com/product/69.html

更新时间:2026-05-28 11:59:22