大数据治理下的数据处理 构建高效、合规的数据价值链

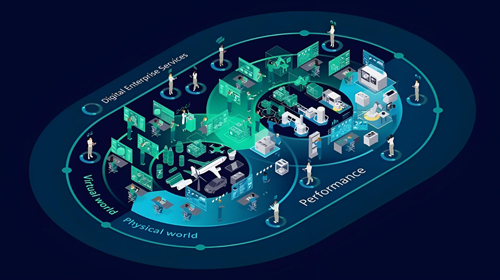

在数字化浪潮席卷全球的今天,数据已成为与土地、劳动力、资本、技术并列的第五大生产要素。海量、多源、异构的数据本身并不能直接创造价值。未经治理的原始数据如同未经冶炼的矿石,其潜力被混乱、低质和安全风险所掩盖。因此,大数据治理,特别是其核心环节——数据处理,已成为企业挖掘数据金矿、驱动智能决策的关键引擎。一套科学、系统的大数据治理解决方案,旨在为数据处理的全过程建立秩序、保障质量、确保安全,从而构建一条从原始数据到智慧洞察的高效、合规的价值链。

一、 数据处理在大数据治理中的核心地位

数据处理是指对原始数据进行采集、清洗、转换、集成、存储、计算和分析等一系列操作,使其转变为可用于分析、应用和支持决策的规范化信息的过程。在大数据治理的框架中,数据处理不仅是技术实现层面,更是连接数据战略、数据质量、数据安全与数据应用的核心枢纽。它确保了治理策略能够落地,使数据从“负担”变为“资产”。

二、 大数据治理解决方案中数据处理的关键环节

一个完整的大数据处理流程,通常包含以下治理驱动的关键环节:

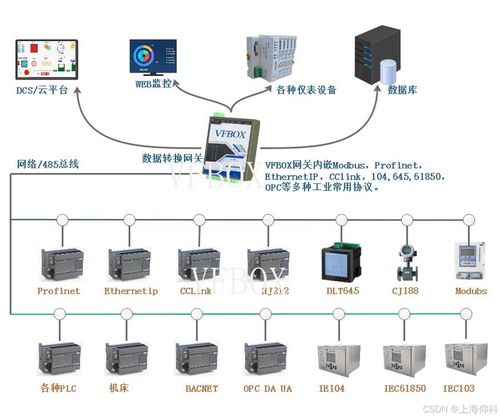

- 数据采集与接入治理:制定统一的数据接入标准与规范,明确数据源的责任主体。通过API接口、日志采集、数据库同步等多种方式,实现多源异构数据的实时或批量、合规采集,并记录数据血缘的起始点。

- 数据清洗与质量提升:这是数据处理的“净化”阶段。基于预定义的数据质量规则(如完整性、准确性、一致性、唯一性、时效性),自动或半自动地检测并处理数据中的错误、缺失、重复和异常值。建立数据质量监控看板,实现问题的可追溯与闭环管理。

- 数据转换与标准化:将来自不同源头、格式不一的数据,按照统一的业务模型和标准进行转换、映射和格式化。例如,统一日期格式、度量单位、代码值,建立企业级主数据(如客户、产品)和关键业务指标的标准定义,消除数据孤岛。

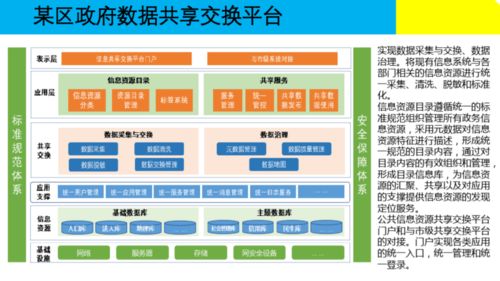

- 数据集成与建模:通过数据仓库、数据湖或数据湖仓一体等架构,将清洗和标准化后的数据进行整合与分层存储(如ODS、DWD、DWS、ADS)。基于维度建模等方法,构建主题明确、易于理解和分析的数据模型,服务于不同的业务场景。

- 数据计算与加工治理:对集成的数据进行聚合、统计、挖掘等计算,生成衍生指标和高级特征。在此过程中,需对计算逻辑、算法模型进行版本管理和血缘追踪,确保计算过程的透明、可复现和可审计。

- 数据存储与生命周期管理:根据数据的访问频率、价值密度和合规要求,制定分级存储策略(热、温、冷数据)和保留期限策略。自动执行数据的归档、销毁,在满足业务需求的优化存储成本并降低合规风险。

- 数据安全与隐私处理:贯穿数据处理全生命周期的安全防护。包括对敏感数据(如个人信息)进行脱敏、加密、匿名化处理;实施基于角色的访问控制(RBAC),确保数据“可用不可见”;记录完整的数据操作审计日志,满足GDPR、个保法等法规的合规要求。

三、 实施有效数据处理治理的支撑要素

要确保上述环节顺畅运行,需要强大的支撑体系:

- 组织与流程:建立跨部门的数据治理委员会,明确数据所有者、管理者和使用者的职责。制定标准化的数据处理流程和审批制度。

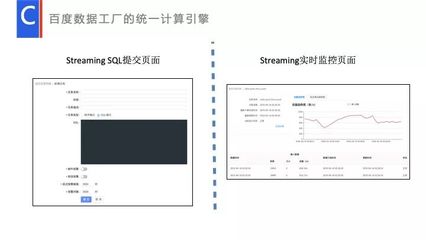

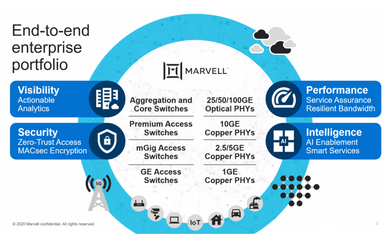

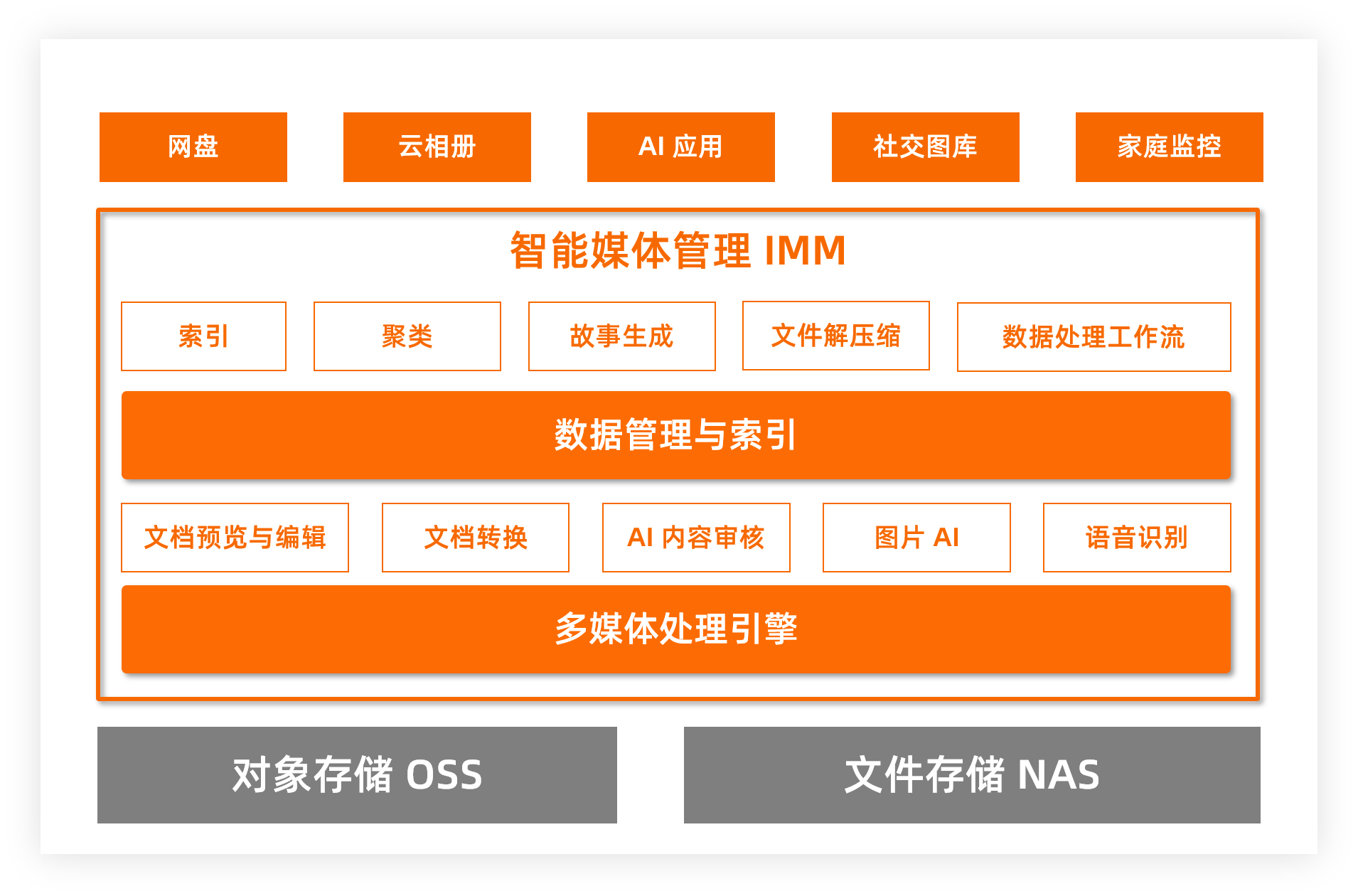

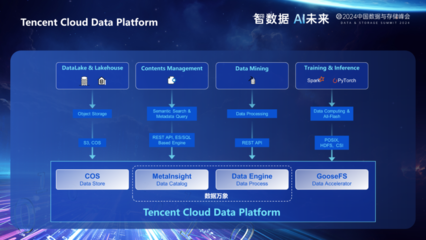

- 技术平台与工具:采用集数据集成、开发、质量、安全、元数据管理于一体的数据中台或数据治理平台,实现流程自动化与可视化。

- 元数据与数据血缘管理:建立企业级数据目录,清晰定义和管理所有数据的业务含义、技术属性、加工逻辑和流转关系。通过数据血缘图,能快速追溯数据来源、分析变更影响,这是数据可信度的基石。

- 持续监控与度量:建立关键数据质量指标、处理任务性能指标和成本消耗指标的监控体系,通过持续度量驱动流程优化和治理水平提升。

四、

大数据治理背景下的数据处理,已远非简单的技术作业,而是一项融合了技术、管理、流程与合规的系统工程。它通过一系列规范化的流程与控制措施,将原始、混沌的数据流,梳理成高质量、高价值、高可信度的数据产品与服务。只有夯实数据处理这一基石,企业才能确保其数据分析结果准确可靠,数据驱动决策科学有效,最终在激烈的市场竞争中,凭借数据优势赢得先机,实现可持续的数字化转型与智能升级。

如若转载,请注明出处:http://www.chinaapmdata.com/product/67.html

更新时间:2026-05-28 13:35:04